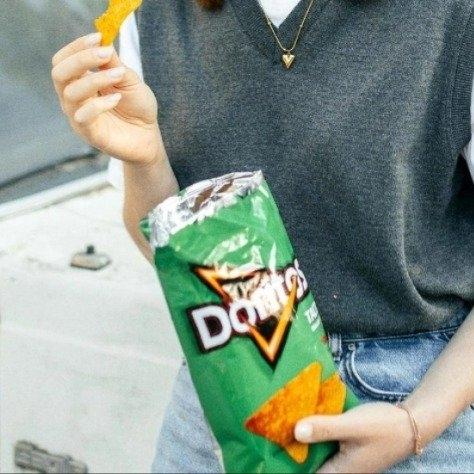

一包薯片引发的“警报危机”:AI误判暴露技术信任困境 美国马里兰州巴尔的摩县Kenwood高中外,16岁学生塔基·艾伦怎么也没想到,自己手里的一包多力多滋薯片会触发一场“惊魂剧”。监控系统AI将薯片包装袋误判为手枪,8辆警车呼啸而至,持枪警察命令他跪地、戴手铐、搜身。当警察举着“疑似枪支”的照片质问时,塔基才发现——照片里自己双手握薯片袋、伸出一根手指的姿势,竟被AI识别成了持枪手势。 这场荒诞剧的背后,是学校去年启用的AI枪支检测系统。该系统通过校园摄像头实时分析画面,一旦检测到“疑似武器”便自动向校方和警方报警。技术公司声称,系统设计包含人工复核环节,但此次事件中,人工审查员虽已标记“无威胁”,校长却未注意到这条更新信息,仍通知校园安全小组,最终导致警方大规模出动。技术公司事后致歉,却将责任归为“真实世界枪支检测的复杂性”,这种“系统无错”的回应,反而激化了公众对AI技术可靠性的质疑。 这场乌龙事件,撕开了AI技术过度依赖的隐忧。学校为保障安全引入AI监控,本意是好的,但当技术误判将普通学生推入危险境地,当8辆警车的阵仗让“安全措施”变成“安全威胁”,我们不得不问:用AI替代人工判断,究竟是降低了风险,还是转移了风险?更讽刺的是,技术公司强调“流程运作如设计”,却选择性忽略了关键环节——如果人工复核的信息无法有效传递,再精密的算法也不过是“盲人摸象”。 公众的愤怒,源于对技术滥用的恐惧。当AI开始主导校园安全,当学生可能因为一个手势、一件物品被贴上“危险”标签,这种“宁可错杀一千”的逻辑,本质上是对人性的漠视。塔基的祖父拉蒙特·戴维斯说:“没人希望自己的孩子经历这种事。”这句话,道出了所有家长的心声——我们愿意接受技术进步,但绝不能以牺牲孩子的尊严和安全为代价。 这场风波也暴露了AI技术伦理的空白。技术公司可以道歉,但谁来为学生的心理创伤负责?校长未注意到复核信息,是否反映出系统设计对“人为因素”的忽视?更重要的是,当AI误判成为常态,我们是否正在用技术制造新的不平等?毕竟,不是每个被误判的学生都能像塔基一样,最终证明自己的“清白”。 技术不是洪水猛兽,但盲目崇拜技术才是。AI可以辅助判断,却不能替代人性;算法可以提高效率,却不能取代责任。这场“薯片危机”应该成为一个警钟:在追求技术先进的同时,我们必须守住人性的底线。 你怎么看待AI技术过度介入生活?如果是你,会愿意让自己的孩子处于这种“技术监控”之下吗?评论区聊聊你的想法吧。 (案例来源:潇湘晨报)