[CL]《Deep Self-Evolving Reasoning》Z Liu, S Zheng, X Wen, Y Wang... [Microsoft Research Asia & Peking University] (2025)

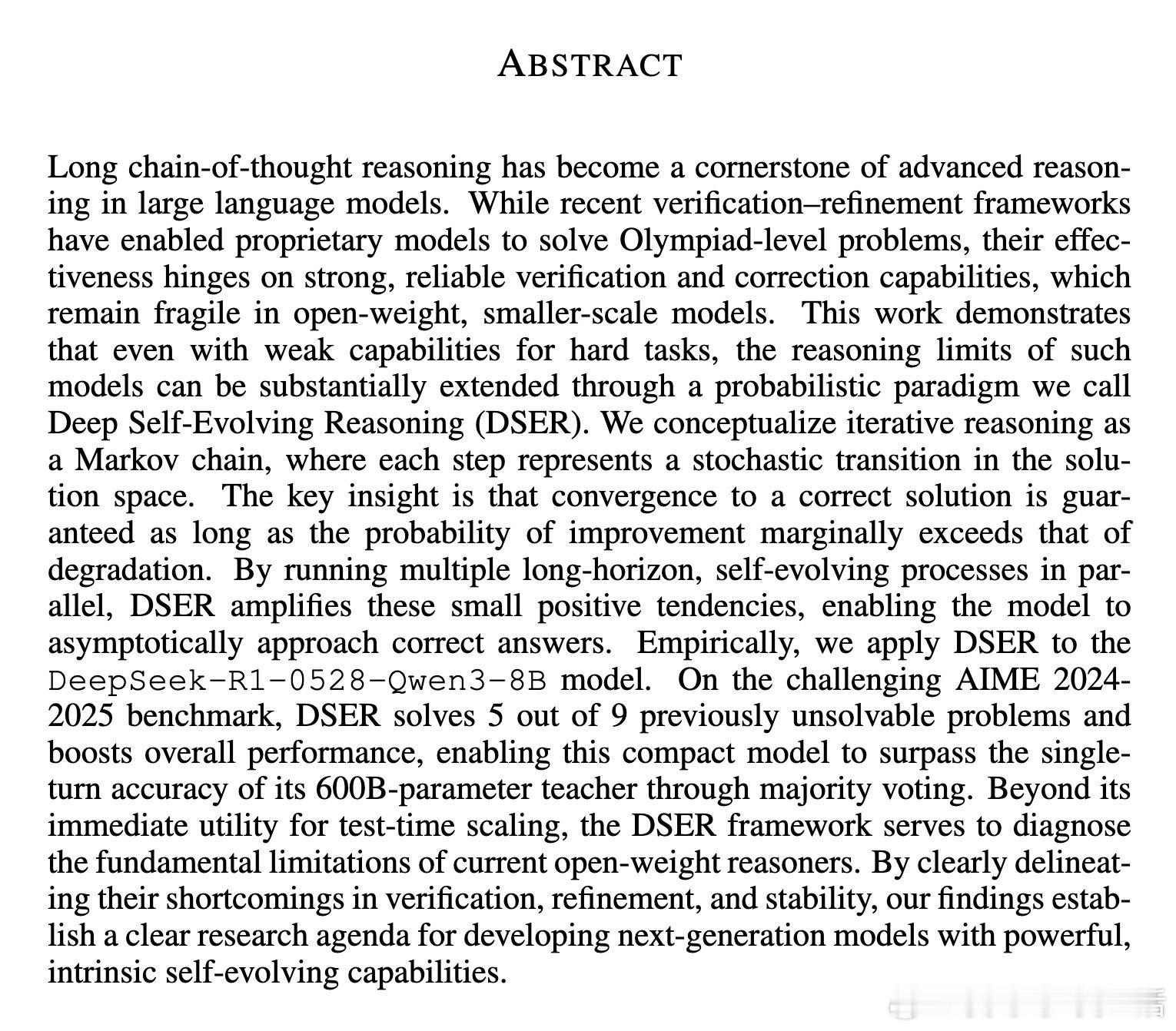

本文提出了一种创新的概率论框架,大幅提升了开源、小规模语言模型的复杂推理能力,突破了以往仅依赖精确验证与修正的限制。

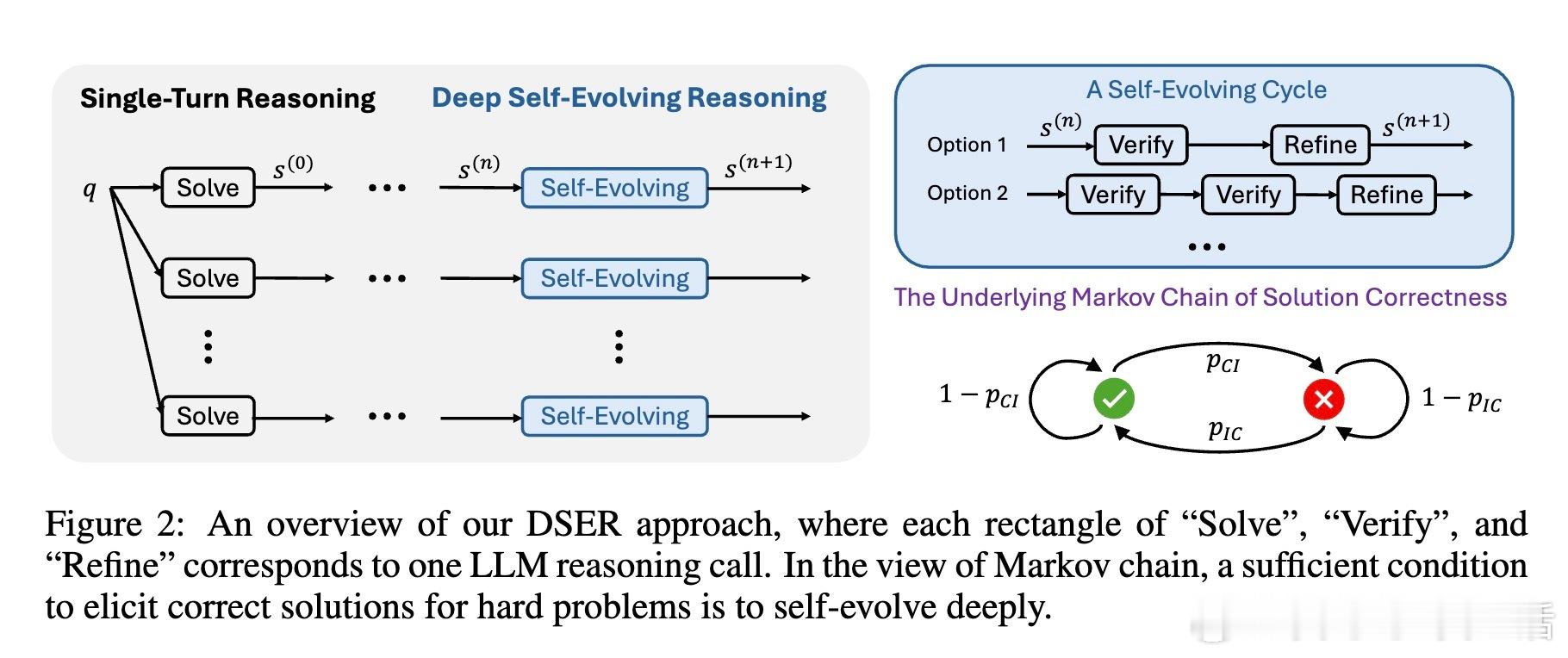

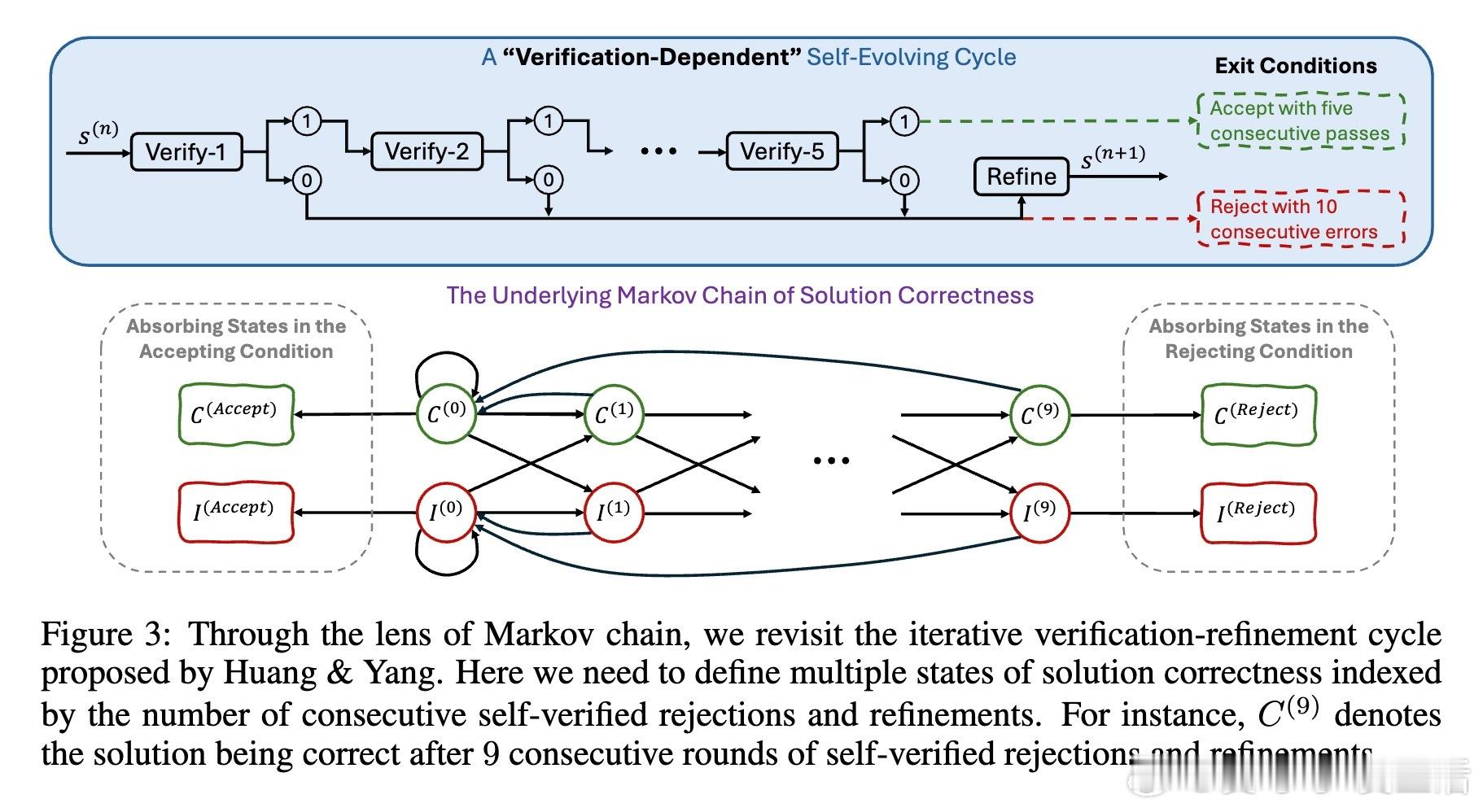

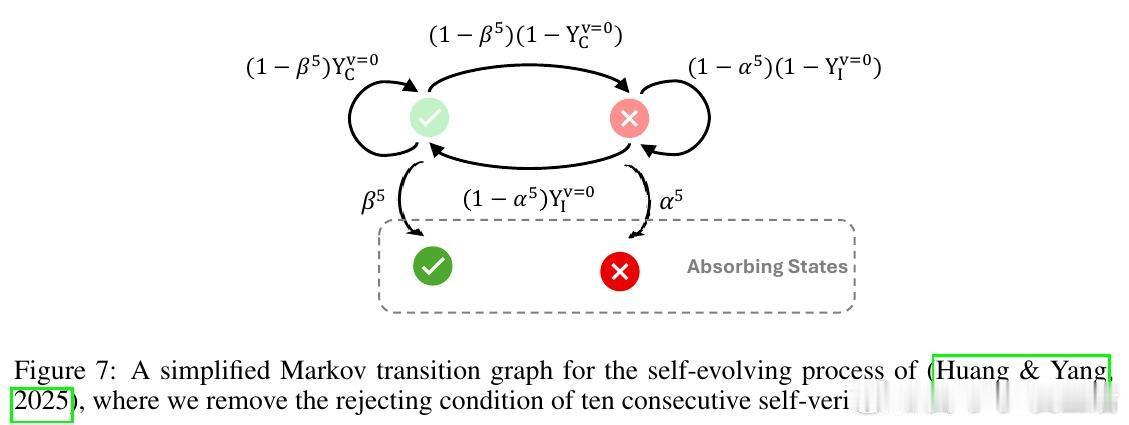

核心思想是将迭代推理视为一个马尔可夫链过程,每一步解的状态存在“改进”或“退化”的概率。只要模型自我改进的概率略大于退化概率,经过多轮深度自我进化迭代,模型就能逐渐收敛到正确解。此方法无需每轮验证和修正都完美,依靠长时间和多进程的并行自演化,极大增强了模型的推理边界。

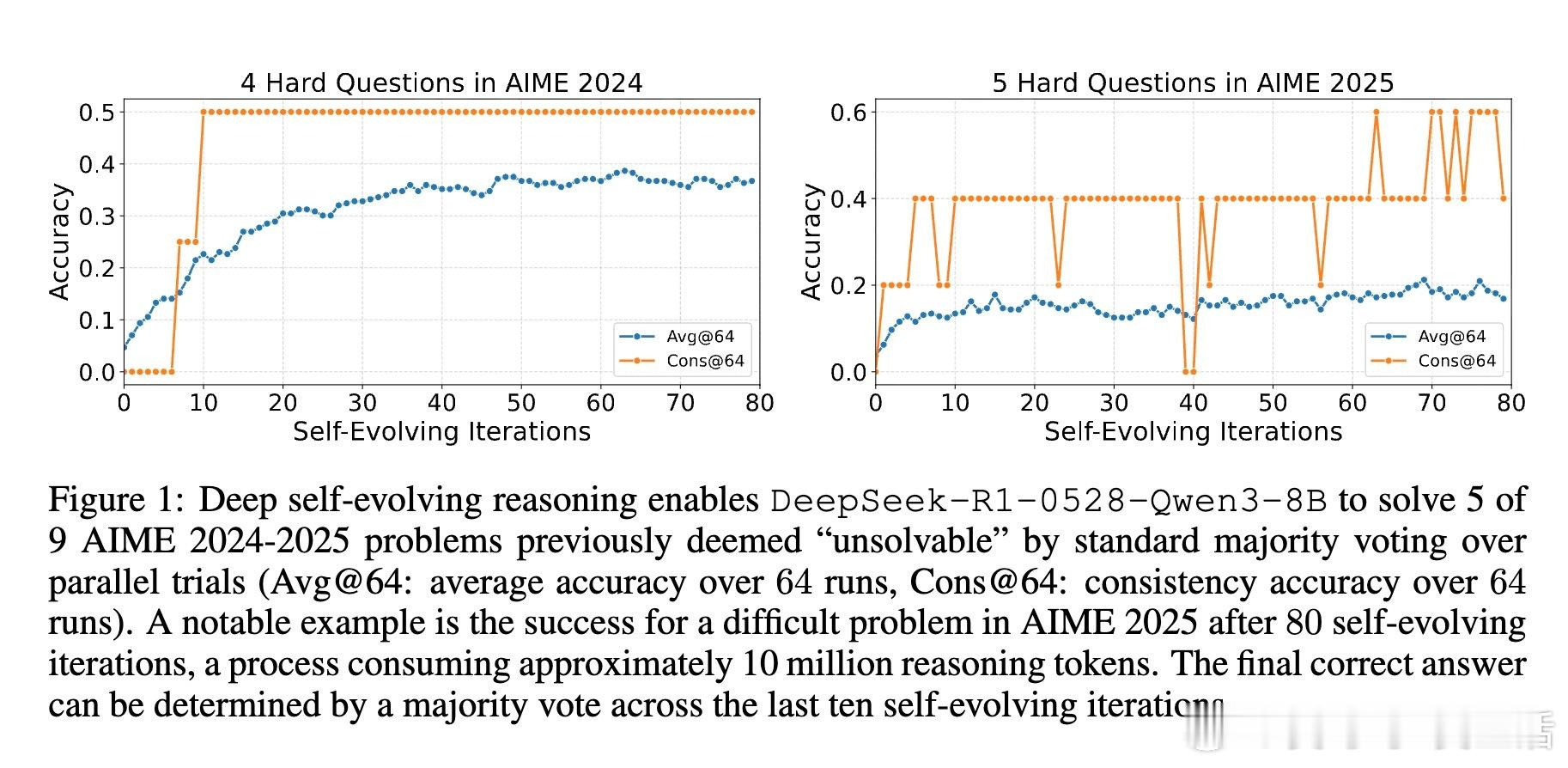

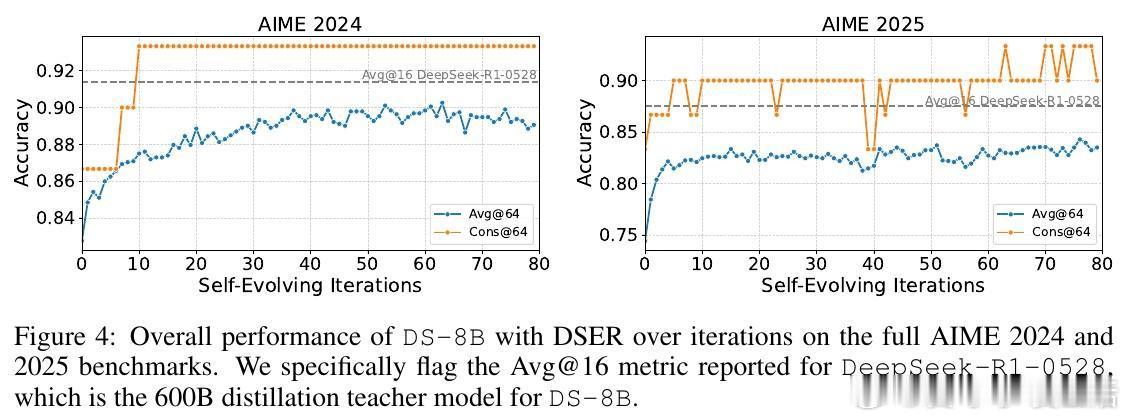

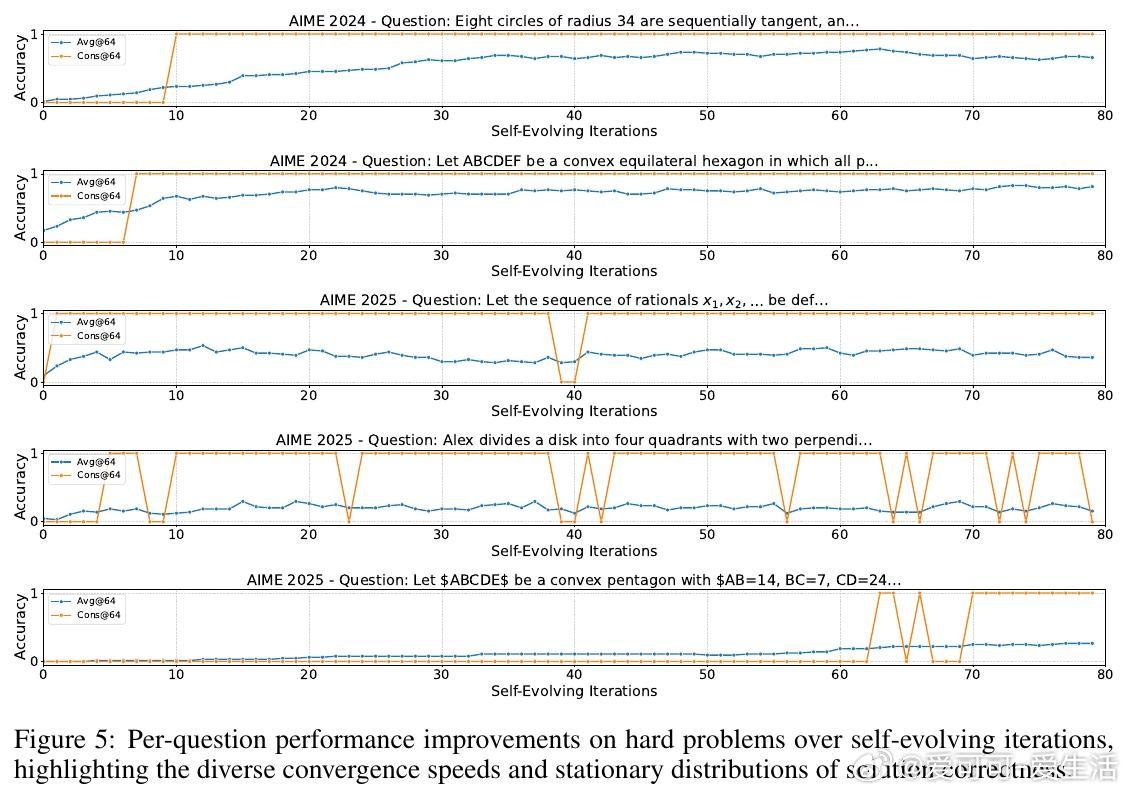

实证中,研究团队基于8亿参数的DeepSeek-R1-0528-Qwen3-8B模型,使用DSER成功解决了AIME 2024-2025数学竞赛中9个之前无法攻克的难题中的5个,整体准确率提升6.5%-9.0%,甚至超越了600亿参数的教师模型单轮推理表现。图示数据显示,即使推理迭代达到80轮,DSER依然稳定提升正确率,且多数投票机制保障了最终解的可靠性。

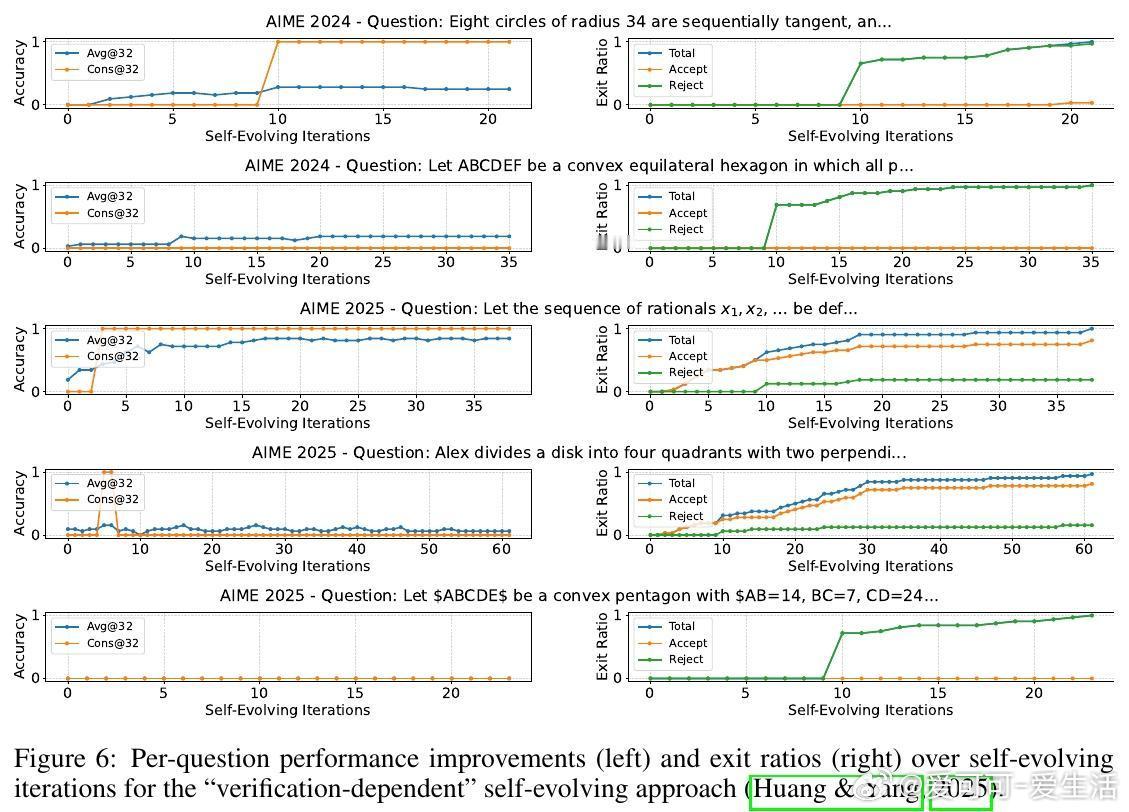

与现有依赖严格自我验证的迭代修正框架相比,DSER摒弃了过度依赖验证结果的“接受”或“拒绝”终止条件,避免了因验证失误导致的早期终止或错误确认,因而在开源模型中表现更稳健。理论与实验证明,DSER为模型提供了一个全新的“推理深度扩展”路径,弥补了当前模型在自我验证、反馈与稳定性上的不足。

未来展望方面,研究指出DSER框架可以作为设计更优训练目标的依据,激励模型提高自我纠错和改进的概率;也有望与强化学习探索阶段结合,挖掘更优推理路径。此外,更高效的搜索策略和可学习的验证机制将赋能DSER,推动下一代具备内在自我进化能力的语言模型发展。

总结来说,这项工作开创性地证明了“推理能力不一定通过单纯增大模型规模实现”,而是可通过设计更聪明的推理迭代机制,充分利用测试时计算资源,使得小规模开源模型也能进行深度、自我进化的复杂推理,极大降低了高性能推理系统的门槛。

全文详见:

人工智能 语言模型 深度学习 推理能力 开源模型 自我进化 马尔可夫链 DSER