为什么FANformer能在大语言模型中脱颖而出?

逆袭,总是让人血脉喷张。

这次,主角是一款新型大语言模型FANformer。

谁也没想到,在大语言模型的世界里,它静悄悄地出现,却悄然逆袭了市场上那些“大腕”级别的老牌模型。

今天,我们来聊聊这个令人好奇的故事。

口口相传中,我们总是听到FANformer这个名字。

大家讨论它很有意思,但是你知道它为什么这么受关注吗?

它最大的特点就是融合了傅里叶分析网络(Fourier Analysis Network,简称FAN)。

这个名字可能听起来有些复杂,但别急,简单来说,就是它能够更好地捕捉数据中的周期性特征。

这样一说,可能还不够直观。

想象一下,你在手机上听歌,如果播放设备能更好地识别旋律的频率和变化,不同音调的还原度更高,那么你听到的音乐会更加和谐动听。

这正是FANformer的“内功”,让它在处理各种数据时更精准,从而提升了性能。

咱们先来看看几个有趣的数据。

大家都知OpenAI推出的GPT-4.5,是行业内的“元老级”强者,各项评分都非常好,但DeepSeek-V3悄悄赶超了GPT-4.5。

在2024年的AIME测试中,DeepSeek-V3的Pass@1准确率达到了39.2%,而GPT-4.5仅为36.7%;在SWE-bench Verified上的表现也是如此,DeepSeek-V3更是得到了42%的准确率,GPT-4.5才38%。

这些数据差距虽然看上去不大,但它们在业内却引起了不小的震动。

我们得从一个更高层次来看,DeepSeek-V3以及后来的FANformer,就像是一匹黑马,正在逐步蚕食老牌模型的市场份额。

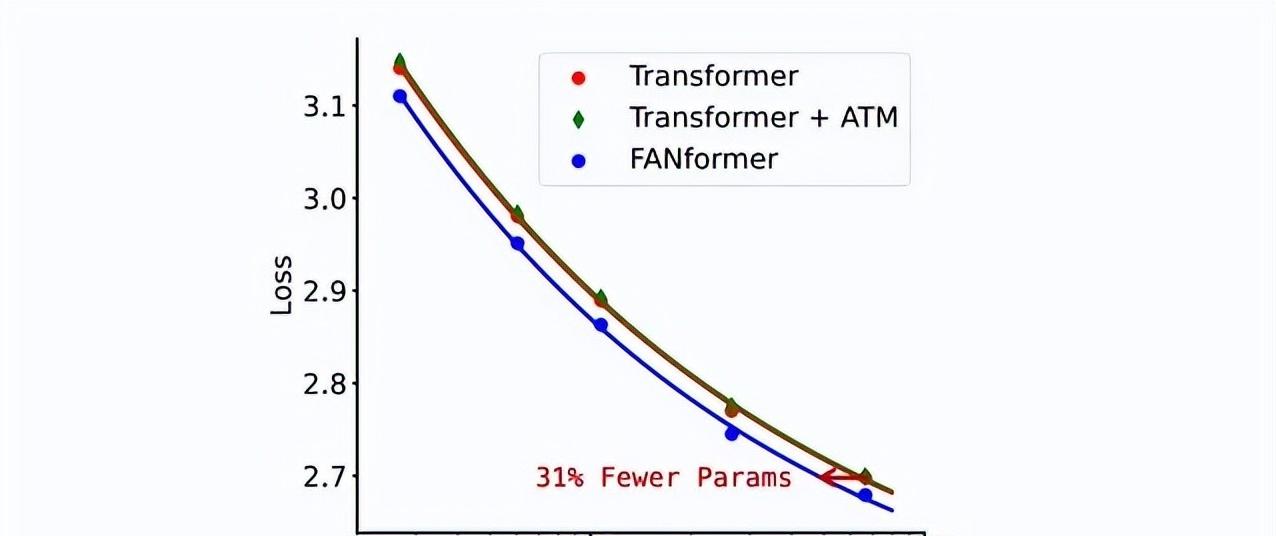

傅里叶分析网络的优势与应用说到傅里叶分析网络,有点像是一种特异功能。

你可以理解为它能够“听懂”数据中的节奏。

一般神经网络在处理数据时,通常会忽视这些细微的周期性变化,从而在某些任务中表现不佳。

而FAN通过直接引入傅里叶变换,使得网络可以识别和处理周期性的信号。

例如,对复杂的模函数建模,传统的Transformer往往力不从心,但FAN却能轻松应对。

傅里叶变换就像是给数据做了一次全面的梳理,把那些重要的、有规律的信息提取出来,让模型在训练时可以更加高效。

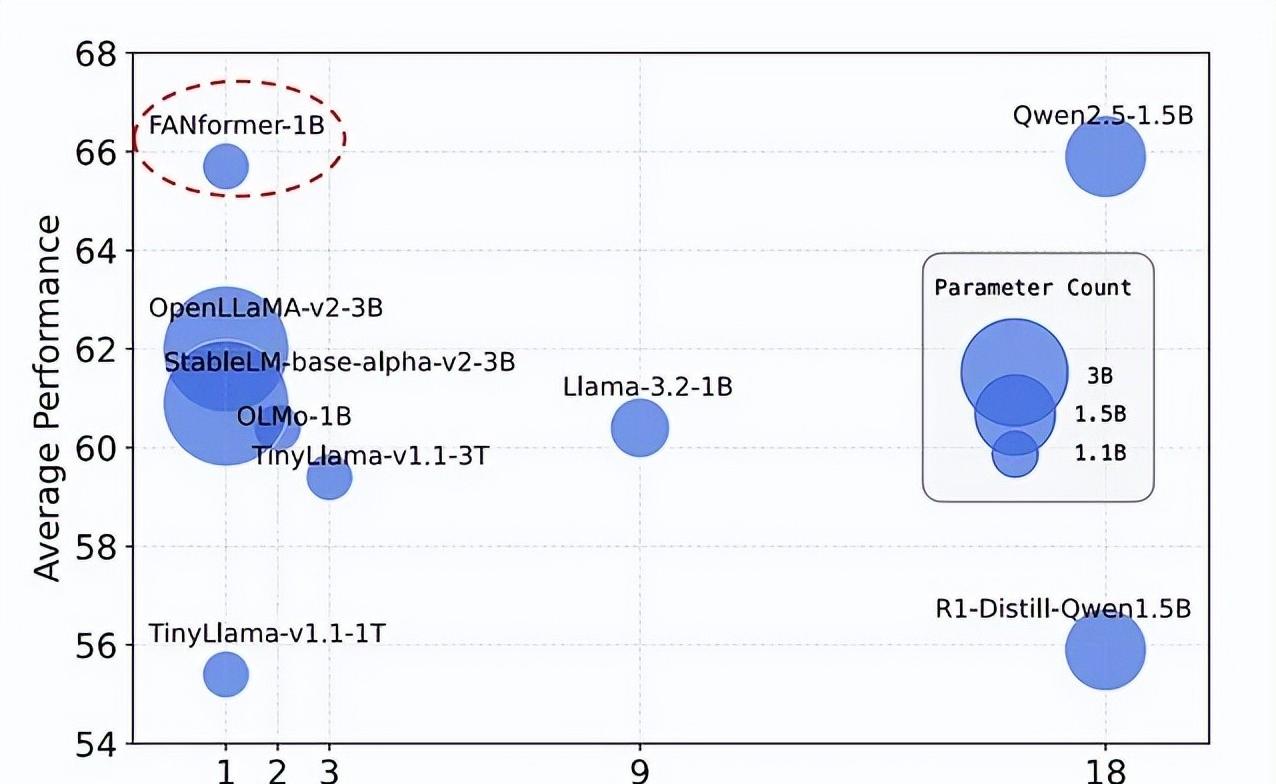

FANformer在下游任务中的优异表现FANformer的亮眼表现不止于基准测试,还在各种下游任务中都有出色的发挥。

在几乎所有下游任务的零样本测试中,FANformer-1B都牢牢领先其他开源模型。

这些任务包括高级推理、布尔问题回答、常识推理完成、开放书籍问题回答等等。

每个任务都有其难度,而FANformer始终能够出色完成,表现得如同一名全能选手。

让人的心里不禁感叹,究竟是什么让这款模型如此厉害?

归根结底,是底层的技术创新带来的质变。

总结起来,FANformer的成功并不只是偶然,而是多年技术积累的必然结果。

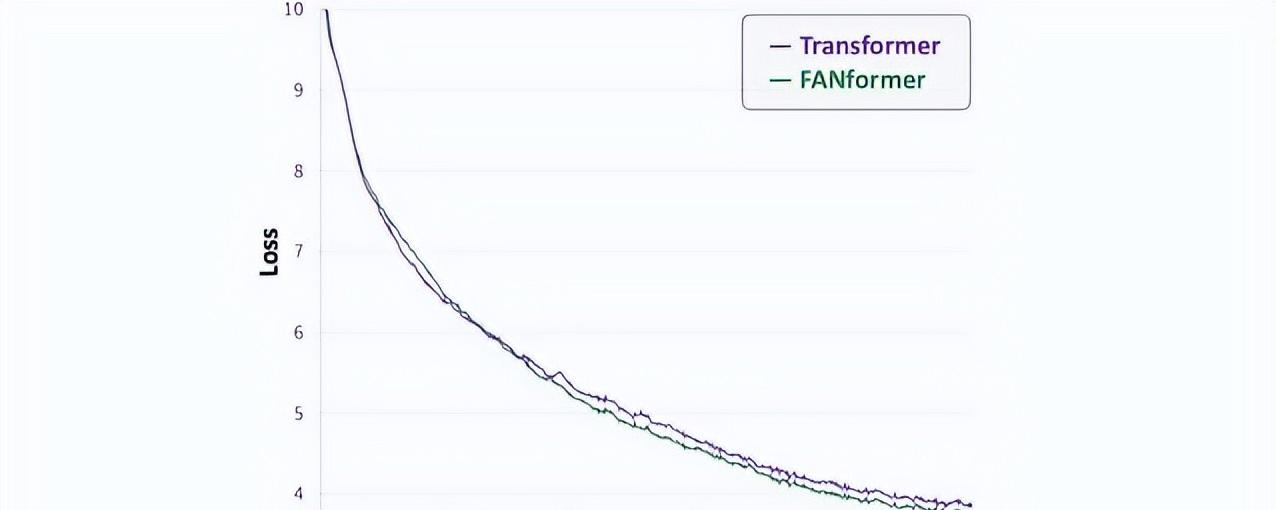

它通过将周期性捕获能力显式编码到深度神经网络架构中,不仅提升了性能还增强了泛化能力。

也许我们在未来会看到更多像FANformer这样的模型出现。

这不禁让人思考,传统的大语言模型是不是该迎来一次全新的变革?

也许这种创新正在悄然展开,技术总在推陈出新,谁能适应变化,谁就能引领未来。

未来的人工智能大生态中,像FANformer这样的新兴技术能量,可能会成为新一代巨头的基石,帮助无数行业迈向新的高峰。